机器学习基本概念

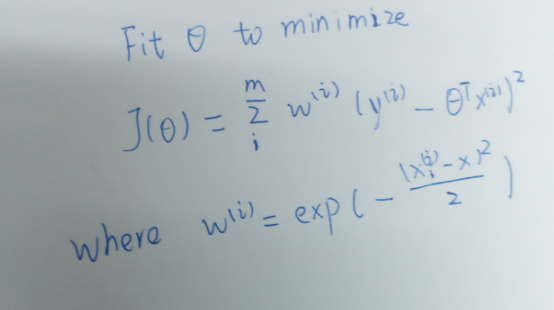

局部加权回归(locally weighted regression)LWR

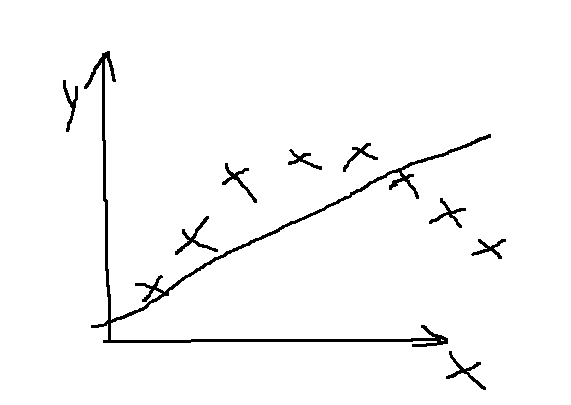

1 | 我们在现实生活中的模型,大多数情况下不能够用线性模型去拟合。如果采用线性模型去拟合就会产生欠拟合(under-fitting),如下图的分布(专业的画图工具比较复杂,就随便画一下吧): |

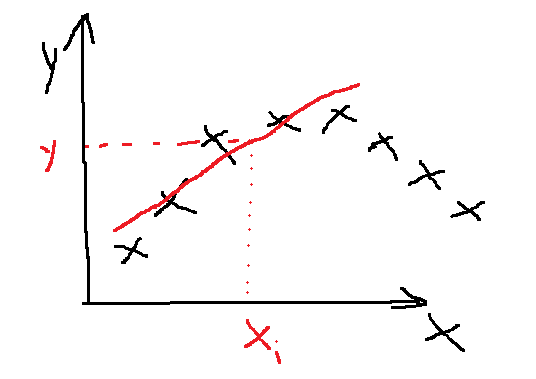

但是我们可以在一个局部邻域里面来用直线拟合

参考链接—-https://blog.csdn.net/u014686356/article/details/53354110

神经网络训练过程中的验证集validation_data

可以将验证集看成时一种特殊的训练数据集,能够帮助我们学习好的超参数。这种方法也叫hold out方法,因为validation_data是从训练集中保留出来的一部分。

参考链接—-https://blog.csdn.net/ai543064193/article/details/80492467

代价函数,损失函数的区别

损失函数(Loss Function )是定义在单个样本上的,算的是一个样本的误差。

代价函数(Cost Function )是定义在整个训练集上的,是所有样本误差的平均,也就是损失函数的平均。

论文相关名词概念

训练集

评论加载中